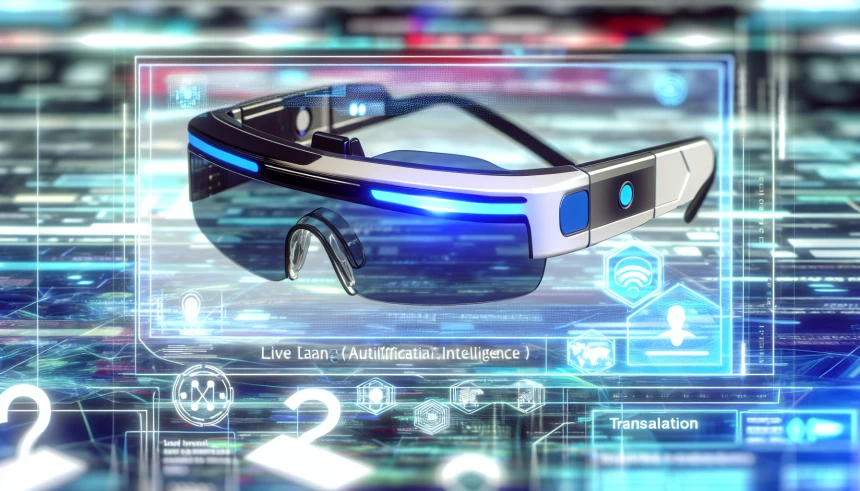

Meta представляет новые функции для умных очков Ray-Ban

Meta анонсировала три новые функции для своих умных очков Ray-Ban: живой ИИ, живые переводы и Shazam. Эти обновления являются частью стремления крупных технологических компаний к интеграции ИИ-ассистентов в умные очки.

Meta объявила о запуске трёх новых функций для своих умных очков Ray-Ban: живой ИИ, живые переводы и Shazam. Функции живого ИИ и живых переводов в настоящее время доступны только участникам программы раннего доступа Meta, тогда как поддержка Shazam доступна всем пользователям в США и Канаде.

Живой ИИ позволяет вести естественные беседы с ассистентом Meta, давая пользователям возможность взаимодействовать с ним, пока он непрерывно анализирует их окружение. Например, находясь в отделе продуктов в магазине, пользователи могут попросить ИИ предложить рецепты на основе ингредиентов, которые они рассматривают. Эта функция может использоваться около 30 минут при полном заряде.

Живые переводы, с другой стороны, позволяют очкам переводить речь в реальном времени между английским и испанским, французским или итальянским языками. Пользователи могут выбрать прослушивание переводов через очки или просмотр транскрипций на своём телефоне. Языковые пары необходимо загрузить заранее, и пользователи должны указать свой язык и язык собеседника.

Поддержка Shazam более проста; пользователям достаточно просто активировать Meta AI, когда они слышат песню, и очки её идентифицируют. Эти функции являются частью обновления программного обеспечения v11 для очков и требуют версии v196 приложения Meta View.

Эти обновления совпадают с усилиями крупных технологических компаний по продвижению ИИ-ассистентов как основы умных очков. Технический директор Meta Эндрю Босворт недавно заявил, что 2024 год стал годом, когда ИИ-очки достигли своего расцвета, предполагая, что умные очки могут быть лучшей формой для действительно нативного устройства с ИИ.